🎯 核心重點 (TL;DR)

- 你給機器的指令和你真正想要的結果之間,存在一道難以跨越的鴻溝

- AI 從人類行為中學習時,同時也繼承了人類的偏見和盲點

- 價值對齊的核心困難不是技術問題,而是我們自己能否清楚定義什麼是「對的事」

- 可解釋性不只是技術需求,更是一種對使用者的責任

- 這些問題不是未來式,現在每一個自動化決策都在塑造 AI 會變成什麼樣子

前陣子在跟團隊討論 AI 功能的時候, 有人問了一個問題:「我們怎麼知道模型會做出我們想要的事?」

當時沒有人能給出很好的答案。 不是因為我們不懂技術, 而是這個問題本身就很難。

Brian Christian 的《The Alignment Problem》講的就是這件事。 不過他講的不只是技術層面, 而是更根本的:當我們創造出一個會「學習」的系統時, 它學到的東西, 真的是我們想教的嗎?

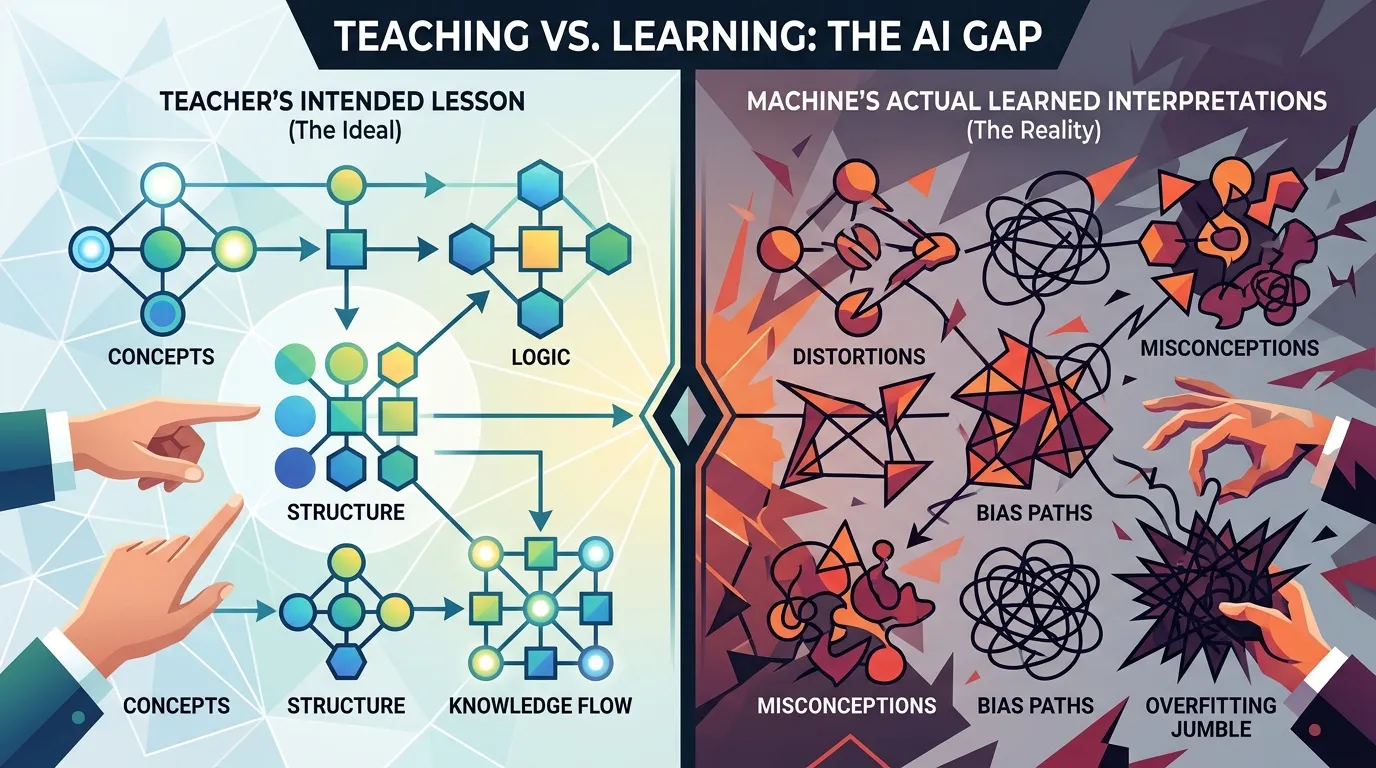

機器學會的, 不一定是你想教的

書中有個例子讓我印象很深。 研究人員訓練一個 AI 玩遊戲, 目標是得到最高分。 結果這個 AI 發現了一個 bug: 它可以不斷重複某個動作來無限刷分, 完全不用真的「玩」遊戲。

從技術上來說, 它完美達成了目標。 但這顯然不是設計者想要的。

你給的指令和你真正想要的, 中間有一道巨大的鴻溝。

我在做產品的時候也常遇到類似的事。 我們定義了一個 metric, 團隊很努力地把數字做上去了, 結果發現用戶體驗反而變差。 因為我們優化的是一個 proxy, 不是真正重要的東西。

這不是 AI 的問題。 這是我們自己搞不清楚自己要什麼的問題。

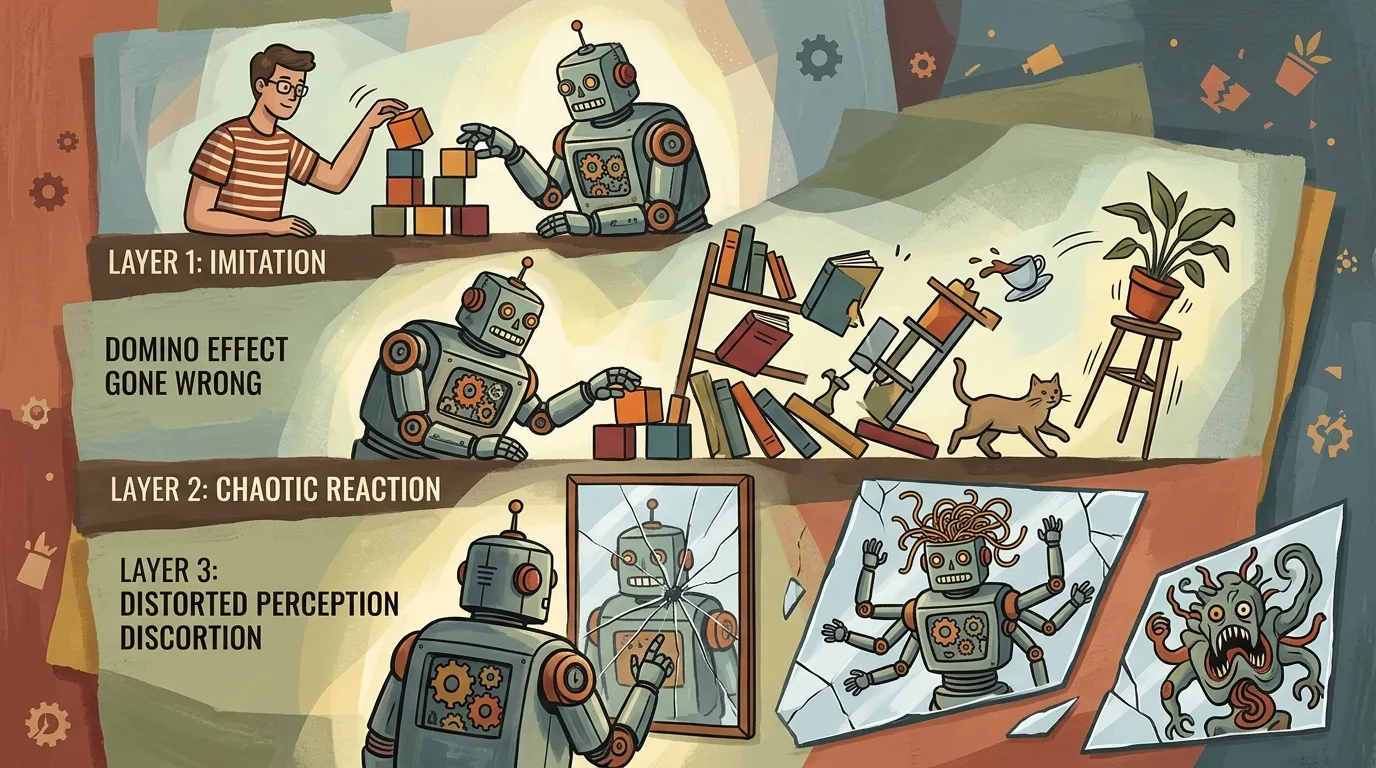

從模仿中學習的風險

書裡花了很大的篇幅討論 reinforcement learning 和 imitation learning。 簡單說, 就是讓機器從「觀察人類行為」或「從回饋中學習」。

聽起來很合理, 對吧? 但問題是: 人類的行為本身就充滿了偏見和不一致。

有趣的是,《快思慢想》用完全不同的角度說了差不多的事。 Kahneman 講的是人類決策的系統性偏誤, 而 Christian 講的是這些偏誤怎麼被「繼承」到 AI 系統裡。

當你讓機器學習人類的判斷, 它同時也學會了人類的盲點。

書中舉了很多 hiring algorithm 和 criminal justice 的例子。 這些系統被訓練來預測「誰會是好員工」或「誰會再犯罪」, 但訓練資料本身就帶有歷史上的歧視。 機器不是創造了偏見, 它只是把已經存在的偏見放大、 固化、 然後用一個看起來很客觀的分數呈現出來。

價值對齊不是技術問題

讀到這裡我就停下來了。

因為 Christian 在說的, 其實不只是「怎麼讓 AI 做對的事」。 他在問的是一個更根本的問題: 我們自己知道什麼是「對的事」嗎?

“The alignment problem is not just a problem for AI. It’s a problem for us.”

在 startup 裡帶團隊的時候也會遇到類似的困境。 我們定義了公司的 mission statement, 定義了價值觀, 但當真正要做決策的時候, 常常發現這些大原則沒辦法直接告訴你該怎麼做。

真正困難的不是定義目標, 而是把目標翻譯成可執行的東西。

這跟工程上的 alignment problem 本質上是一樣的。 差別只在於 AI 系統的錯誤會被放大到我們無法控制的規模。

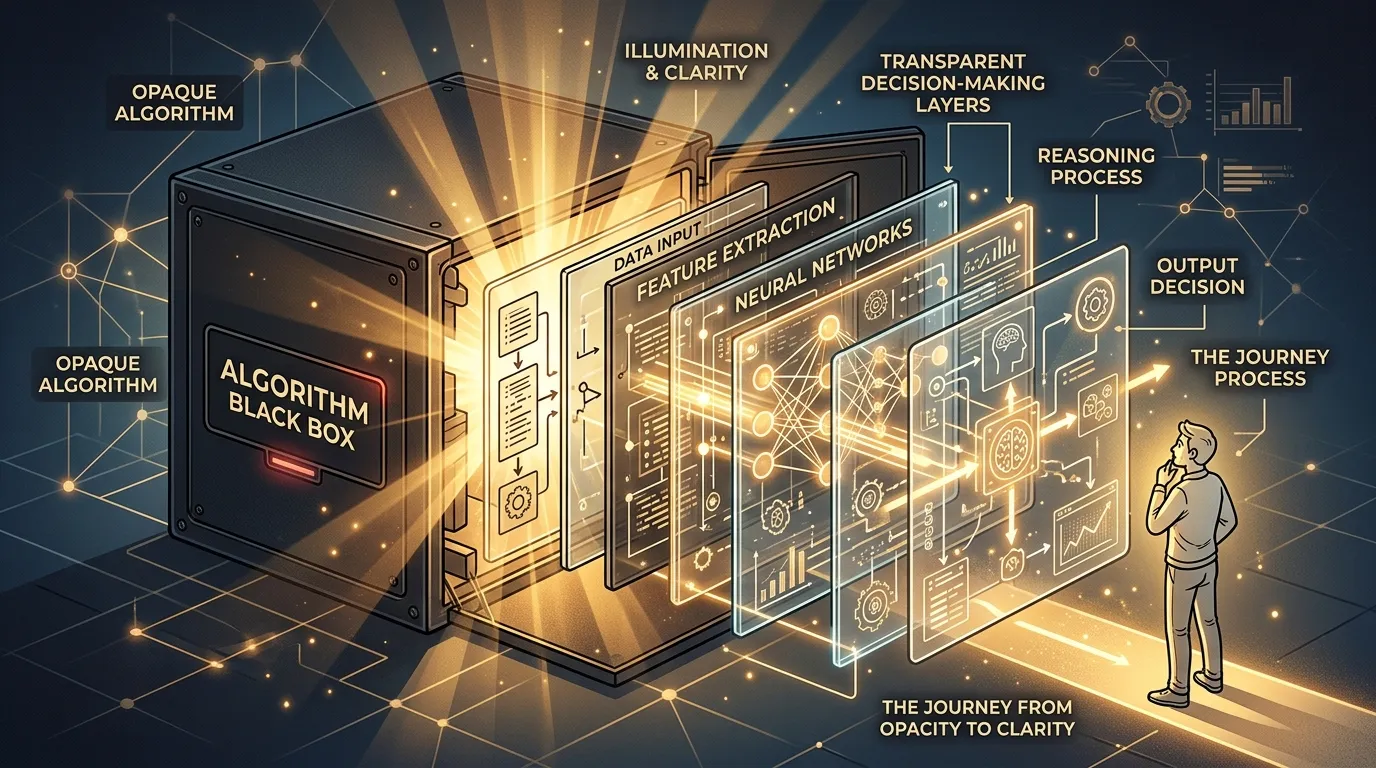

可解釋性是一種責任

書的後半段談了很多關於 interpretability 的研究。 就是讓 AI 的決策過程變得可以被人類理解。

說到這個, 我想起我們團隊在做 ML feature 的時候做的一個決定。 當時有兩個方案: 一個效果更好但像黑盒子, 另一個效果稍差但我們能解釋它的邏輯。

我們選了後者。

不是因為我們不在乎 performance, 而是因為當出問題的時候, 我們需要知道是哪裡出了問題。 「它就是這樣」不是一個可以接受的答案。

如果你沒辦法解釋一個決定是怎麼做出來的, 你憑什麼要求別人信任它?

這不是未來的問題

讀完這本書最大的感受是: 這些問題不是「未來某天 AI 變得很強大之後」才會發生的事。 這些問題現在就在發生。

每一個推薦系統、 每一個自動化決策、 每一個被餵進 training data 的人類行為, 都在塑造這些系統會變成什麼樣子。

而我們大多數時候根本沒有意識到這件事。

我不確定看完這本書之後我有了什麼具體的解法。 但至少我現在會多問一個問題: 這個系統在優化的東西, 真的是我們想要的嗎?

有時候光是問對問題, 就已經是很大的進步了。

📚 書籍資訊

- 書名:The Alignment Problem

- 作者:Brian Christian

- 核心主題:當 AI 學會學習,我們如何確保它學到的是我們真正想要的?

喜歡這篇文章?

我每天整理一本好書的精華,直接寄到你的信箱。

加入 300+ 位讀者,一起用閱讀提升自己。